[핵심 요약 리포트]

- 분석 대상: 고용노동부 HRD-Net API 연동 및 공공데이터 전처리 실무 경험 분석

- 주요 팩트 1: 정형화된 동행복권 데이터와 달리, 실무 공공데이터는 극심한 결측치와 비표준화 텍스트로 인해 데이터 전처리에 막대한 시간이 소요됨.

- 주요 팩트 2: 최신 AI 모델조차 비정형 데이터의 논리적 결함을 스스로 보정하지 못하고 환각 현상을 일으키는 한계를 보임.

- 결론: 최근 커뮤니티의 데이터 분석가 디시 게시판 등에서 언급되는 실무의 어려움은 바로 이 지독한 전처리 과정에 있으며, 고품질 리포트를 위해서는 분석가의 도메인 지식과 끈기가 필수적임.

안녕하세요. 팩트 데이터 기반 경제 분석 리포트, thininfo입니다.

대학원 시절, 데이터 사이언스를 전공하며 수없이 들었던 말이 있습니다. “Garbage In, Garbage Out (GIGO).” 쓰레기를 넣으면 쓰레기가 나온다.

당시엔 그냥 교과서에 나오는 이론인 줄 알았습니다. 교수님이 던져주시는 ‘아이리스(Iris) 꽃 분류’나 ‘타이타닉 생존자 데이터’는 예쁘게 정제된 온실 속 화초였으니까요.

동행복권 사이트 크롤링 데이터: 데이터 분석가의 ‘천국’

현실의 데이터에서도, 최근 제 블로그에 연재한 로또 통계 분석을 진행한 동행복권 사이트의 데이터는 그야말로 선녀 같았습니다. 1회부터 최신 회차까지 결측치 하나 없이 꽉 채워져 있고 전처리도 거의 필요 없는, 데이터 분석가의 온실이었습니다.

HRD-Net 공공데이터 API: 데이터 분석가의 ‘지옥’

하지만 국비지원 취업률 통계를 분석하기 위해 고용노동부 HRD-Net API를 연동하는 순간, 저는 지옥을 맛봤습니다. 약 1만 건의 데이터를 호출하자 취업률 필드에는 0과 Null이 의미 없이 섞여 있었고, 지역명은 서울, Seoul, 서울특별시로 파편화되어 있었습니다.

게다가 과정명에는 깨진 특수문자가 가득했습니다. 답답한 마음에 최신 AI 툴에 정제를 맡겼지만, AI는 맥락을 이해하지 못하고 엉뚱한 결괏값을 뱉어내는 할루시네이션 증세만 보였습니다.

결국 저는 파이썬을 끄고 엑셀을 켠 뒤, 1만 줄이 넘는 데이터를 눈으로 훑으며 Delete 키를 누르고 수동으로 텍스트를 통일하는 끔찍한 수작업을 밤새워 강행해야 했습니다. 음성 데이터 분석에서 librosa 사용법을 익히며 고군분투하던 시절보다 훨씬 더 소모적인 노가다였습니다.

데이터 사이언스 전공자로서 모니터 앞에서 단순 반복 작업을 하는 제 모습이 처량하기도 했지만, 이 지독한 삽질의 시간은 저에게 데이터 분석의 진정한 민낯을 깨닫게 해주었습니다.

분배

AI도 ‘잘못된 입력’앞에서는 속수무책

현업 데이터 사이언티스트들이 왜 업무 시간의 80퍼센트를 데이터 청소에 쓴다고 하는지 말입니다. 데이터 분석가 현실 디시 등 온라인 커뮤니티에서 실무자들이 토로하는 가장 큰 고충이 바로 이런 쓰레기 데이터와의 싸움입니다.

로또처럼 예쁘게 떠먹여 주는 데이터는 AI가 1초 만에 분석합니다. 하지만 야생의 공공데이터를 닦고 조여서 유의미한 정보로 바꾸는 과정은, 오롯이 분석가의 도메인 지식과 포기하지 않는 끈기에 달려 있습니다.

앞으로 본 블로그에 발행되는 모든 데이터 리포트는, AI가 단숨에 찍어낸 가벼운 글이 아닙니다. 더러운 데이터 구덩이 속에서 제가 직접 곡괭이질을 해서 캐낸, 투박하지만 진실된 숫자들입니다.

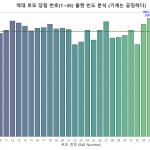

어제 그 끔찍한 전처리 고생을 거쳐 완성해 낸 국비지원 취업률 현실 분석 포스팅은 아래 링크에서 확인하실 수 있습니다. 데이터의 뼈대를 확인해 보시기 바랍니다.

(그 고생을 해서 만든 ‘국비지원 취업률 현실’ 포스팅, 여기를 클릭해서 확인해 보세요.)